知的アルゴリズムの世界:機械学習

2023-12-22更新

知的アルゴリズムの世界: AMD Instinct™ アクセラレーターから見た機械学習

私たちは急速な技術進歩の時代に生きており、「機械学習」という言葉は、私たちの生活のあらゆる面に浸透しています。配信されている映画を見ようと座ったときに提案されるおすすめは、個人の好みに合うように設計されていますし、道路をナビゲートする自動運転車も機械学習の成果によるもので、機械学習はこれらのイノベーションを可能にしています。しかし、機械学習とはいったい何なのでしょうか?

複雑なトピックに対するシンプルな定義

人工知能(AI)の機能の一つである機械学習は、明示的にプログラムされることなく、コンピューターが膨大な量のデータに触れることで、経験から学習し、改善することを可能にするものです。機械学習により、システムはパターンを特定し、新しいデータに適応し、情報に基づいた意思決定や予測を行うことができます。命令によってプログラムの動作が決定される従来のルールベースのプログラミングとは異なり、機械学習はアルゴリズムがデータに基づいて学習し、進化することを可能にします。

「機械学習」という言葉は新しいものではありません。1950年代後半にはアーサー・サミュエルが人工知能を使ってチェッカーゲームをするコンピューターに対して名付けられたという歴史があります。では、概念としての機械学習がNASAと同じくらい古いものだとすると、この概念が一般大衆の関心を集めるまでにこれほど時間がかかったのはなぜなのでしょうか?

要するに、今日の機械学習の人気の高まりは、ビッグデータの出現と、計算能力、メモリ容量、帯域幅の大幅な増加に起因しているのです。

機械学習のビルディングブロック

今日の最新システムは、AIモデルの学習と改善に必要な膨大な量のデータを処理する特性を備えています。これらコンピューターとデータの広大な海がなければ、AIモデルは関連情報を提供するのに時間がかかりすぎることでしょう。つまり、これらのシステムは、実用的で効率的なモデルを開発するために重要な要素を提供しているのです。FrontierやLUMIシステムのようなエクサスケールコンピュータの登場は、計算性能の向上がモデルの性能向上につながることを示す好例だと言えます。

さらに、ニューラルネットワーク(特にニューラルネットワークのサイズの増大)とディープラーニングの黎明期は、機械学習ワークロードの性能をさらに向上させました。このことは、機械学習ワークロードの採用が増加するための「パーフェクト・ストーム」レシピと考えられます。

大量のデータ。機械学習アルゴリズムがデータを学習し、洞察を提供するためには、アルゴリズムがデータのパターンから学習するための情報を必要とします。過去10年間におけるデータの爆発的な増加は、それらのパターンを探すアルゴリズムに「燃料」を供給するために利用可能な、より多くの情報があることを意味するでしょう。

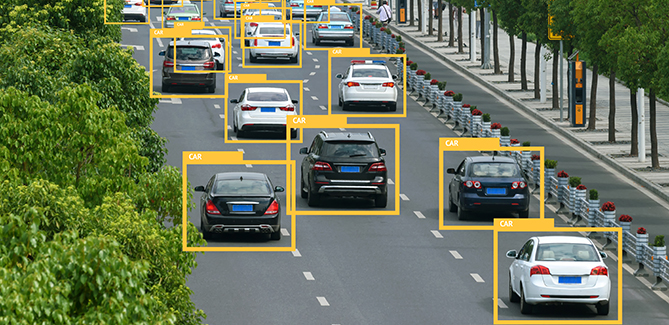

アルゴリズムといえば、データ内の関係を見つけるために設計された数学的構成要素です。例えば、製造現場での目視検査用に書かれたアルゴリズムには、ある部品(例えばエンジンのコネクティングロッド)の様々な状態の画像が何百万枚も送られます。アルゴリズムはこれらの画像からパターンを見つけ、この例で言えば、金属に鋳造工程で生じたバリがあるため、その部品は不良品であると分類することができるのです。

このアルゴリズムは、大量のデータ(上記の例ではコネクティングロッドの写真)にさらすことで、データ内の関係を見つけられるようにするプロセスである学習を通じて、このような結論に達します。そこから、モデルの精度がテストされ、新しいデータにさらすことで評価されます。これは、ハイパーパラメータを調整したり、データセットを強化したり、アルゴリズムを修正したりして、モデルを改善するための反復プロセスです。

機械学習を強化するAMD Instinct™ アクセラレーター

ヘルスケアでは、LUMIシステムにより、研究者は、がんの早期発見と薬効の迅速なシミュレーションが可能なニューラルネットワーク・プログラムを利用できるようになりました。これにより、病理学者が癌の成長を診断し、様々な治療に対するオーダーメイドの患者の反応をシミュレートすることができるため、患者は最高の個別化治療を可能な限り迅速に受けることができます。

KTクラウドは、Infrastructure-as-a-Service (IaaS)、Software-as-a-Service (SaaS)、アプリケーション・プログラミング・インターフェース(API)-11Bパラメータの韓国語大規模言語モデル(LLM)を利用した自動コールセンターおよび商用チャットボット・アプリケーション-といった形で、パブリッククラウド・ユーザー向けにAIクラウド・サービスを提供する意欲的な計画を持っています。

トゥルク大学もまた、ヨーロッパ最大のスーパーコンピュータであるLUMIシステムを活用し、13Bパラメータのフィンランド語大規模言語モデル(LLM)をトレーニングしました。LUMIの試験運用では、ハギング・フェイスが作成した1760億パラメータのBLOOMモデルを、さらに400億語を使ってフィンランド語と組み合わせています。

機械学習の未来

テクノロジーの進歩に伴い、機械学習は進化を続けることでしょう。ディープラーニング、強化学習、量子コンピューティングの進歩は、さらに複雑な問題を解決する可能性を秘めています。未来は未知数ですが、かつては不可能に近いと思われていた課題を解決できるようになるのは楽しみなことです。

こちらの記事はAMD本社のブログ記事を機械翻訳したものです。詳しくは元記事をご覧ください。

脚注:

第三者のサイトへのリンクは便宜上提供されているものであり、明示的に記載されていない限り、AMDはそのようなリンク先のサイトのコンテンツについて責任を負わず、いかなる保証も示唆するものではありません。GD-5

© 2023 Advanced Micro Devices, Inc. 無断複写・転載を禁じます。AMD、AMD Arrowロゴ、AMD Instinct、およびこれらの組み合わせは、Advanced Micro Devices, Inc.の商標です。本書で使用されているその他の製品名は、識別のみを目的としたものであり、各所有者の商標である場合があります。