AMD Instinct™ MI300 シリーズ アクセラレータ

リーダーシップの生成 AI アクセラレータとデータセンター APU

MI300の最新情報ペーパー

無料ダウンロード

AI と HPC を大幅に強化

AMD Instinct™ MI300 シリーズ アクセラレータは、最も要求の厳しい AI や HPC のワークロード処理に高度に特化し、卓越した演算能力、高メモリ集積度、広帯域幅メモリ、特殊なデータ形式へのサポートを提供します。

内部のテクノロジ

AMD Instinct MI300 シリーズ アクセラレータは、マトリックス コア テクノロジを提供する AMD CDNA™ 3 アーキテクチャに基づいて構築されており、高効率の INT8 および FP8 (AI 向けスパース性への対応を含む) から HPC 向けの最も要求の厳しい FP64 まで、幅広い精度をサポートしています。

AMD Instinct MI300X アクセラレータ

AMD Instinct MI300X シリーズ アクセラレータは、生成 AI ワークロードおよび HPC アプリケーション向けにリーダーシップ パフォーマンスを提供するように設計されています。

304 CU

304 個の GPU 演算ユニット

192GB

192GB HBM3 メモリ

5.3TB/s

5.3TB/s ピーク理論メモリ帯域幅

仕様比較

- AI パフォーマンス

- HPC 性能

- メモリ

AI パフォーマンス (ピーク TFLOPs)

競合アクセラレータと比較して最大 1.3 倍の AI パフォーマンス3

HPC 性能 (ピーク TFLOPs)

競合アクセラレータと比較して最大 2.4 倍の HPC 性能4

メモリの容量と帯域幅

競合アクセラレータと比較して 2.4 倍のメモリ容量と 1.6 倍のピーク理論メモリ帯域幅5

AMD Instinct MI300X プラットフォーム

AMD Instinct MI300X プラットフォームは、完全に接続された 8 個の MI300X GPU OAM モジュールを、第 4 世代 AMD Infinity Fabric™ リンクを介して業界標準の OCP 設計に統合し、低レイテンシの AI 処理向けに最大 1.5 TB の HBM3 容量を提供します。すぐに導入可能なこのプラットフォームは、既存の AI ラックやサーバー インフラに MI300X アクセラレータを追加することで、タイム トゥ マーケットの時間を短縮し、開発コストを削減できます。

8 MI300X

8 MI300X GPU OAM モジュール

1.5TB

合計 1.5TB HBM3 メモリ

42.4TB/s

ピーク理論集約メモリ帯域幅 42.4 TB/s

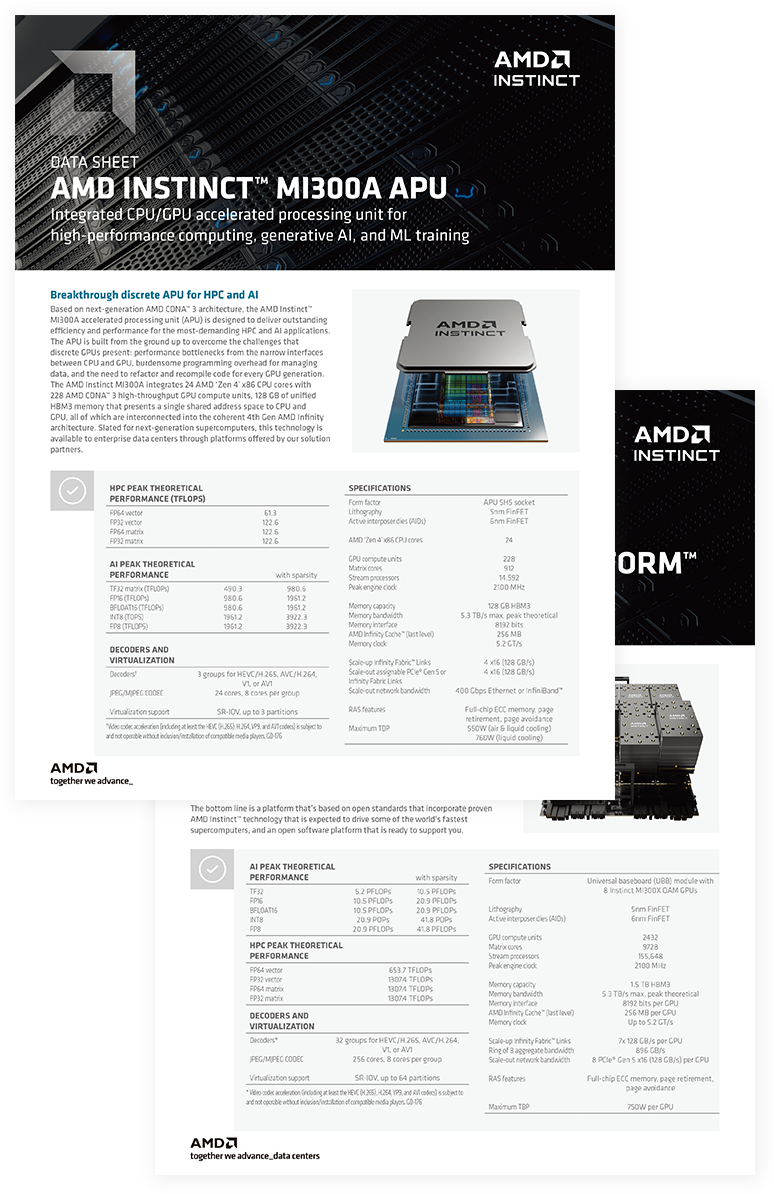

AMD Instinct MI300A APU

AMD Instinct MI300A アクセラレーテッド プロセッシング ユニット (APU) は、AMD Instinct アクセラレータと AMD EPYC™ プロセッサの性能を共有メモリと組み合わせることで、効率性、柔軟性、プログラマビリティを向上させます。AI と HPC の集約を加速し、研究の進展と新たな発見の推進を支援するよう設計されています。

228 CU

228 個の GPU 演算ユニット

24

24 個の "Zen 4" x86 CPU コア

128GB

128 GB の統合された HBM3 メモリ

5.3TB/s

5.3TB/s ピーク理論メモリ帯域幅

仕様比較

- AI パフォーマンス

- HPC 性能

- メモリ

AI パフォーマンス (ピーク TFLOPs)8

HPC 性能 (ピーク TFLOPs)

競合アクセラレータと比較して最大 1.8 倍の HPC 性能9

メモリの容量と帯域幅

競合アクセラレータと比較して 2.4 倍のメモリ容量と 1.6 倍のピーク理論メモリ帯域幅10

エクサスケールのコンピューティングの推進

AMD Instinct アクセラレータは、ローレンス リバモア国立研究所の El Capitan システムなど、世界トップクラスのスーパーコンピューターに搭載されています。この 2 エクサスケールのスーパーコンピューターが、AI を利用してどのように史上初のシミュレーションを実行し、科学研究を前進させているのかをご覧ください。

最新情報を入手する

サインアップして、最新のデータセンター ニュースとサーバー コンテンツを受信します。

MI300の最新情報ペーパー無料ダウンロード

AI 向け新GPU製品 Instinct MI300X および Instinct MI300Aの詳細をご紹介します。

MI300の最新情報ペーパー

無料ダウンロード